智能客服

场景介绍

智能语音客服是一种利用人工智能和语音识别技术来实现自动化交互和问题解决的客户服务系统。在 AI 大模型出现之前,智能客服主要利用自然语言处理和机器学习算法来理解客户的意图,依赖于预设的规则和知识库来进行问题解答。随着 LLM 的发展,越来越多的智能客服接入了大模型的能力,LLM 技术使智能语音客服能够更好地理解对话的上下文,从而实现连贯的对话交流。

RTC 技术的引入,为智能语音客服带来了实时通信的能力。这意味着智能客服可以更加迅速地响应客户的需求,提供即时的反馈和解决方案。同时,Tencent RTC 还支持多人通话、屏幕共享等功能,进一步提升了客户服务的效率和质量。

实现方案

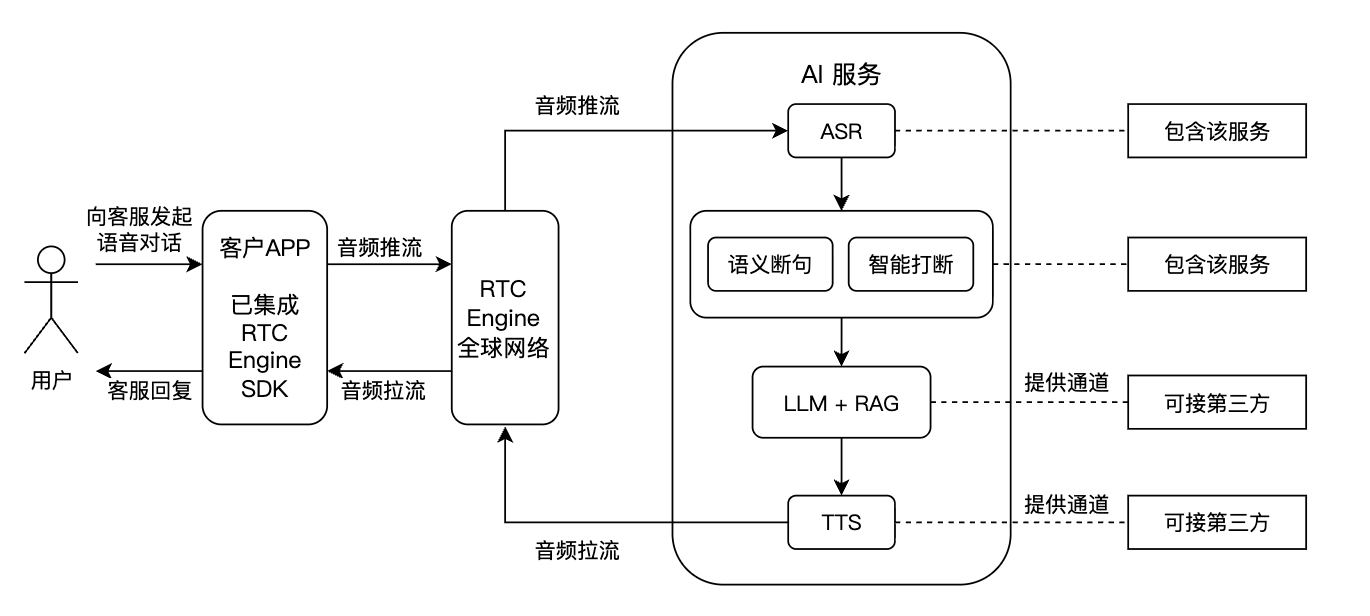

通常实现一个完整的智能客服场景,需要涉及到多个模块:实时音视频、AI 实时对话、LLM、TTS 等。每个模块下的关键动作及功能点如下表所示:

功能 | AI 智能客服场景应用 |

实时音视频 | 流式传输技术可以确保语音和视频数据的连续性和稳定性,减少延迟和抖动,提供接近于真人客服通话的高质量体验。用户可以与智能客服系统进行更自然的对话,就像是在和真人客服交谈一样,这种互动体验可以显著提升用户满意度。 |

AI 实时对话 | 腾讯 AI 实时对话解决方案,支持客户灵活接入多家 AI 大模型服务,实现 AI 与用户之间的实时音视频互动,打造符合业务场景的 AI 实时对话能力。基于腾讯 RTC 全球低延迟传输,语音对话延迟低至1s,对话效果自然拟真,接入便捷,开箱即用。 |

大语言模型 LLM | LLM 技术使智能语音客服能够更好地理解对话的上下文,从而实现连贯的对话交流。LLM 可以捕捉对话中的语义和语境信息,识别用户意图,并将上一轮对话的内容与当前对话关联起来。 |

文字转语音 TTS | 支持接入第三方 TTS,通过在模型中引入个性化的训练数据或调整模型的参数,可以生成符合特定要求的语音输出。智能语音客服可以根据用户的偏好或特定场景的需求,提供不同的语音风格。 |

方案架构

前提条件

准备 LLM

使用 RAG

在智能客服的场景中,企业需要上传自有的知识集合,包括各类文档、问答素材等,这就需要用到 LLM+RAG 增强检索的能力。开发者可以在自己的业务后台实现与 OpenAI API 兼容的大模型接口,并将封装了上下文逻辑的大模型请求发送给第三方大模型。

注意:

使用 LLM 的 RAG 或 Function Call 等能力,一般会增加 LLM 的首 Token 耗时,从而增加 AI 回复的延迟。如果应用场景对延迟敏感,推荐使用SystemPrompt 来替代 RAG 功能。

准备 TTS

使用腾讯云 TTS:

您需要 开通应用的 TTS 服务 以使用 TTS 语音合成功能。

APPID 可前往 账号信息 获取。

SecretId 和 SecretKey 可前往 API 密钥管理 获取,SecretKey 仅支持在创建密钥时查看,请及时保存。

可前往 音色列表 获取可调整的音色。

使用第三方或自定义 TTS:目前支持的 TTS 文字转语音配置(TTSConfig)。

准备 RTC Engine

注意:

接入步骤

高级功能

常见问题

方案配套产品

系统层级 | 产品名称 | 场景用途 |

接入层 | 提供低延时、高品质的音视频实时互动解决方案,是音视频通话场景的基础底座能力。 | |

云端服务 | 实现 AI 与用户之间的实时音视频互动,打造符合业务场景的 AI 实时对话能力。 | |

大模型 | 智能客服的大脑,提供 LLM+RAG、Workflow、Multi-agent 等多种智能体开发框架。 | |

数据存储 | 提供音频录制文件、音频切片文件的存储服务。 |