デジタル時代において、ライブストリーミングは私たちのオンライン体験に欠かせない要素となっています。ゲーム配信からライブニュースの報道まで、これらのリアルタイム動画伝送の背後にある技術は複雑で魅力的です。このブログ記事では、ライブストリーミングサービスの精巧なアーキテクチャを探求し、各コンポーネントを分解して、それらがどのように連携してシームレスなライブ動画体験を提供するかを説明します。

ライブストリーミングアーキテクチャの概要

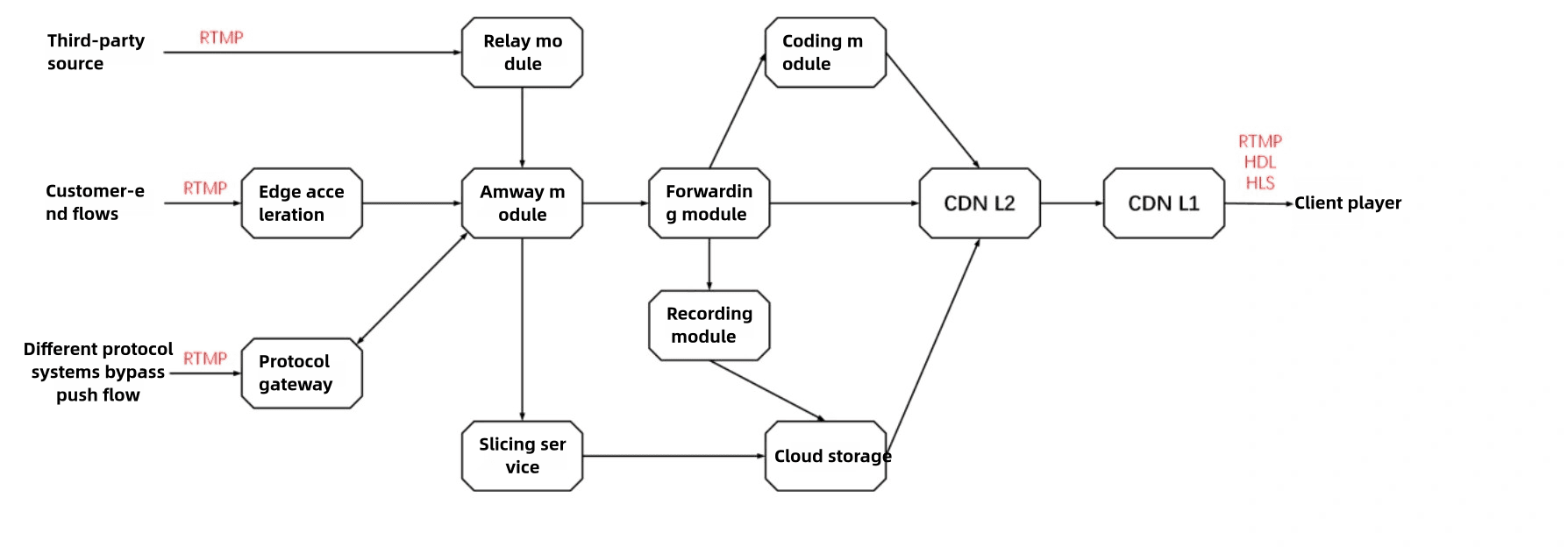

ライブストリーミングサービスは、ビデオキャプチャから配信までのすべてを扱う洗練されたインフラストラクチャの上に構築されています。まず、典型的なライブストリーミングアーキテクチャの高レベルな概要を見てみましょう:

この図は、ライブストリーミングサービスに関与するさまざまなコンポーネントを示しています。この記事全体を通じて、これらのコンポーネントの詳細に深く掘り下げていきます。

ライブ動画のソース

ライブ動画は、いくつかのソースから発生することがあります:

クライアント側ストリーミングツール:これには、OBS(Open Broadcaster Software)やTencent Cloud Mobile Live SDKなどの人気のあるソフトウェアが含まれます。これらのツールを使用すると、ユーザーは自分のデバイスから直接ビデオをキャプチャしてストリーミングできます。

サードパーティのストリームソース:他のプロバイダーからのストリームや再放送される既存の公共ストリームなどです。

その他のプロトコルシステム:例えば、リアルタイムオーディオビデオシステムからルーティングされたストリームです。

ストリーム取り込みモジュール

ストリーム取り込みモジュールは、受信したオーディオおよびビデオストリームを受け取り、必要に応じてプロトコル変換を行います。このモジュールは、いくつかのシナリオを処理します:

RTMPからRTMPへ:この場合、プロトコルやパッケージングの変換は必要ありません。ただし、メッセージブロックの順序を再整理してから、ストリームを配信モジュールに転送することがあります。

RTMPからHDL(HTTPダイナミックライブ)へ:これはプロトコル変換(RTMPからHTTP)が必要ですが、パッケージング形式の変更(FLVはFLVのまま)は不要です。

RTMPからHLS(HTTPライブストリーミング)へ:このシナリオでは、プロトコル変換(RTMPからHTTP)とパッケージング変換(FLVからTS)が両方必要です。その後、ストリームはさらなる処理のためにセグメンテーションサービスに転送されます。

フォワーディングモジュール

その名の通り、フォワーディングモジュールはデータをシステムの異なる部分にルーティングする役割を担っています:

CDN配信:ストリームは、最終ユーザーに配信するためにコンテンツ配信ネットワーク(CDN)に直接送信されることがあります。

録画:モジュールは、ストリームを録画サービスに転送し、ライブストリームデータをクラウドストレージに保存します。これにより、ビデオオンデマンドシステムでのライブストリームのリプレイ機能が可能になります。

トランスコーディング:ストリームは、リアルタイム変換のためにトランスコーディングサービスに送信されることがあります。これは、さまざまなデバイスやネットワーク条件に合わせて異なる解像度とビットレートのストリームの複数のバージョンを作成するのに便利です。ただし、リアルタイムトランスコーディングは通常、3〜6秒の遅延を引き起こします。

CDN配信と再生

処理後、ストリームはCDNを介して配信されます。クライアントデバイスのプレイヤーは、プルURLを使用してストリームデータを取得し、再生します。このプロセスには、不正アクセスを防ぐためのいくつかのセキュリティ対策が含まれます:

- URLパラメータ認証

- User-Agent(UA)確認

- リファラー確認

- IPブラックリスト/ホワイトリスト

完全なライブストリーミングパイプライン

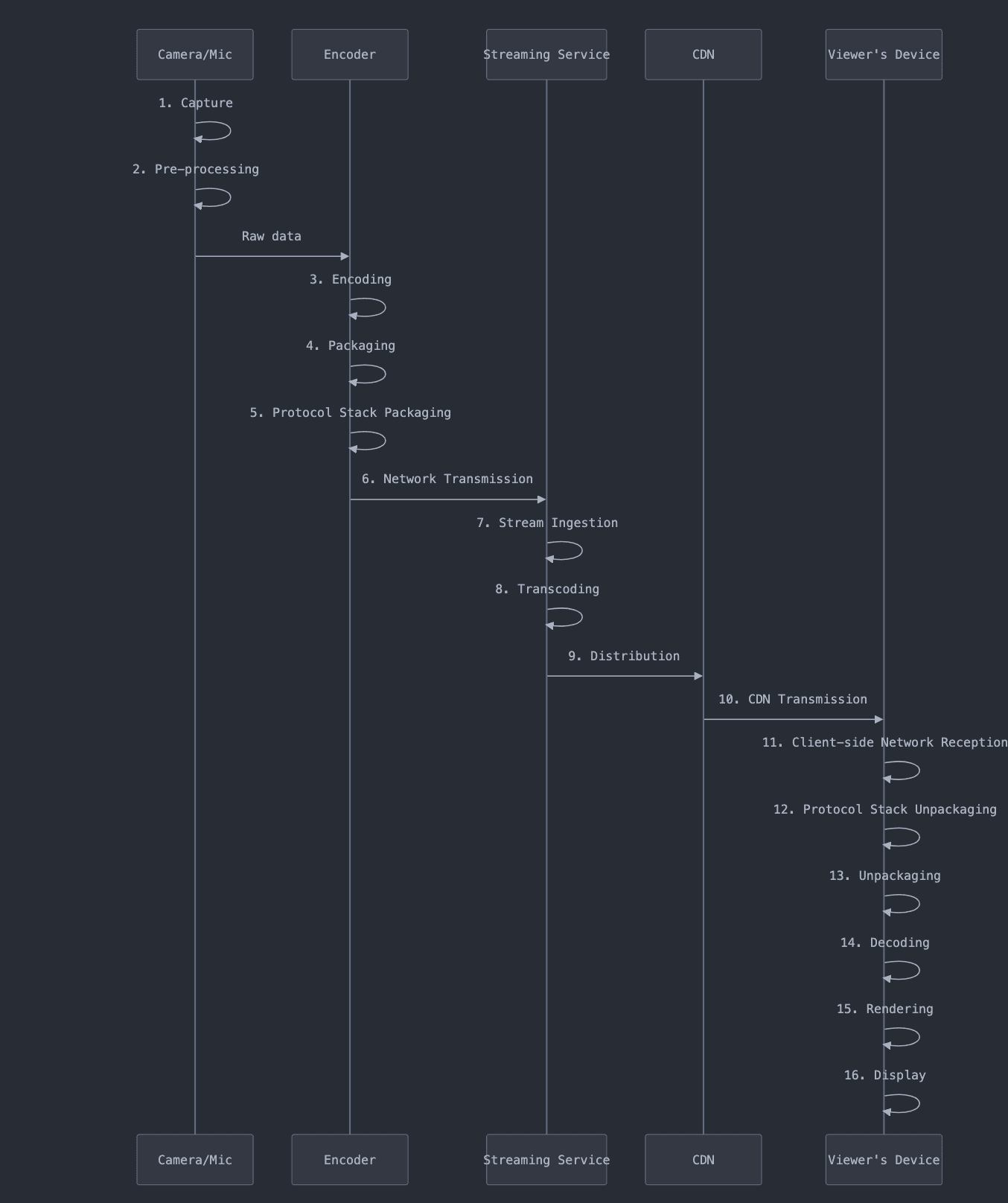

ライブストリーミングプロセスを完全に理解するために、キャプチャから表示までの全パイプラインを分解してみましょう:

- キャプチャ:カメラとマイクロフォンでビデオとオーディオをキャプチャします。

- 前処理:生データを処理して品質を向上させたり、効果を追加したりします。

- エンコーディング:処理されたデータは、ビデオおよびオーディオコーデックを使用して圧縮されます。

- パッケージング:エンコードされたデータは、コンテナ形式(例:FLV、MPEG-TS)にパッケージ化されます。

- プロトコルスタックパッケージング:パッケージ化されたデータは、特定のプロトコル(例:RTMP、HLS)を使用して伝送の準備がされます。

- ネットワーク伝送:データはインターネットを介してストリーミングサービスに送信されます。

- ストリーム取り込み:サービスは、受信したストリームを受け取り、処理します。

- トランスコーディング:必要に応じて、ストリームは異なる品質と形式に変換されます。

- 配信:処理されたストリームはCDNノードに送信されます。

- CDN伝送:CDNノードが異なる場所の視聴者にストリームを配信します。

- クライアント側ネットワーク受信:視聴者のデバイスがストリームデータを受信します。

- プロトコルスタックアンパッケージング:ストリーミングプロトコルが解析されます。

- アンパッケージング:コンテナ形式がアンパッケージ化されます。

- デコーディング:ビデオとオーディオが非圧縮されます。

- レンダリング:デコードされたデータが表示のために準備されます。

- 表示:ビデオが視聴者の画面に表示され、オーディオがスピーカーから再生されます。

このパイプラインの各ステップは、最終的な視聴体験に影響を与える可能性があり、ライブストリーミングシステムの複雑さを強調しています。

ライブストリーミングの主要な課題

私たちが議論したアーキテクチャは強力なライブストリーミング能力を可能にしますが、いくつかの課題も提示します:

レイテンシ:パイプラインの各ステップは、遅延を加えます。このエンドツーエンドのレイテンシを最小限に抑えることは、特にインタラクティブなストリームにとって重要です。

スケーラビリティ:ライブストリーミングシステムは、視聴者数の急増に対応する必要があり、堅牢でスケーラブルなインフラストラクチャが求められます。

サービスの質:さまざまなネットワーク条件やデバイス間で一貫したビデオ品質を維持することは、常に課題です。

セキュリティ:コンテンツを不正アクセスから保護し、ストリーマーと視聴者のプライバシーを確保することは最も重要です。

互換性:幅広いデバイス、ブラウザ、およびネットワーク条件をサポートするには、フォーマットやプロトコルに関する慎重な考慮が必要です。

ライブストリーミングアーキテクチャの未来のトレンド

技術が進化するにつれて、ライブストリーミングサービスのアーキテクチャも進化しています。いくつかの新興トレンドは以下の通りです:

WebRTC統合:Web Real-Time Communication(WebRTC)は、その超低遅延機能のためにますます採用されています。

AIによる強化:機械学習は、リアルタイムのビデオ強化、コンテンツモデレーション、およびパーソナライズされた視聴体験に使用されています。

エッジコンピューティング:エッジコンピューティングを使用して、処理をエンドユーザーに近づけることで、レイテンシを減少させ、スケーラビリティを向上させることができます。

5G統合:5Gネットワークの展開は、高品質のストリームとより信頼性のある接続を可能にし、モバイルライブストリーミングを再形成する可能性があります。

結論

ライブストリーミングサービスのアーキテクチャは、現代技術の驚異であり、さまざまなコンポーネントとプロセスを組み合わせて、世界中にリアルタイムビデオを提供します。ストリーマーが「Go Live」を押す瞬間から、視聴者がそのコンテンツを画面で見る瞬間まで、複雑な一連の操作が行われ、各操作が全体の体験にとって重要です。

ライブビデオの可能性を追求し続ける中で、このアーキテクチャを理解することはますます重要になります。次の大きなストリーミングプラットフォームを構築している開発者であれ、ストリームを最適化したいコンテンツクリエイターであれ、単に好奇心旺盛な視聴者であれ、ライブストリーミング技術の複雑さを理解し感謝することで、この広く普及したデジタルメディアへの理解と感謝が深まります。

ライブストリーミングの未来は明るく、進行中の革新がより没入型でインタラクティブ、かつアクセスしやすい体験を約束します。今後を見据えると、ライブストリーミングサービスのアーキテクチャは、技術の進化に適応し、クリエイターと視聴者の増大する要求に応え続けることが明らかです。